LatentSync

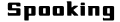

高效口型同步扩散模型(视频对口型)

是字节开源的用于口型同步的扩散模型,只需提供角色视频和要同步的音频即可生成。该模型对硬件的要求适中,仅需 6.5 GB 的 GPU 即可运行,适合大多数开发者和研究人员使用。此外,@fffiloni大佬还提供了一个在线演示可以玩一下。

https://github.com/bytedance/LatentSync

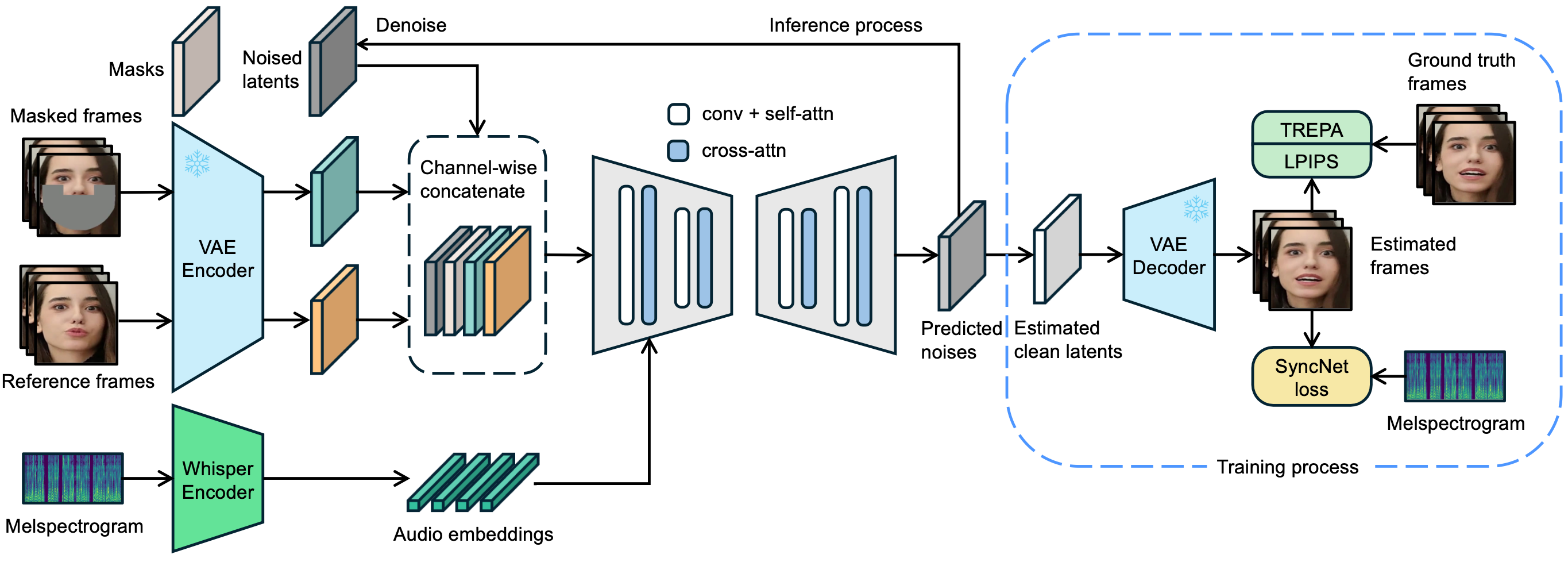

LivePortrait

一个开源的肖像动画生成框架,能够将静态图像与输入参考视频结合,生成逼真的动态表情视频。该框架特别注重泛化能力、可控性和效率,通过提升视频质量的同时优化了框架性能

https://github.com/KwaiVGI/LivePortrait

JoyVASA

基于扩散音频驱动生成人或动物头像的面部及头部动画 (图片生成对口型视频)

https://jdh-algo.github.io/JoyVASA/

本站文章除注明转载/出处外,均为博主 spooking 原创或翻译,转载前请务必署名。